L'induzione è una modalità molto importante di apprendimento delle creature viventi.

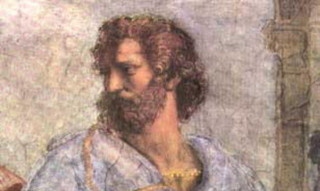

Uno dei primi filosofi ad essere ricorso a questo concetto fu Aristotele il quale, attribuendo a Socrate il merito di averla scoperta, sosteneva che l'induzione fosse, appunto, "il procedimento che dai particolari porta all'universale” (Top., I, 12, 105 a 11).

Sempre secondo Aristotele non sono né i sensi per via induttiva, né la razionalità per via deduttiva, a dare di per sé garanzia di verità, bensì soltanto l'intuizione intellettuale: essa consente di cogliere l'essenza della realtà fornendo dei principi validi e universali, da cui il ragionamento sillogistico trarrà delle conclusioni coerenti con le premesse.

L'apprendimento, la vita e l'evoluzione sono fra di loro correlati.

Infatti la vita e' evoluzione ed evoluzione e' apprendimento di ciò che e' necessario alla sopravvivenza.

Apprendimento e' la capacita' di elaborare le informazioni con intelligenza critica.

Quindi l'elaborazione critica delle informazioni e' vita. (Roberto Bello).

Un semplice esempio può illustrare come si apprende per induzione.

Ipotizziamo di aver di fronte una persona che non abbia mai visto dei contenitori di uso comune come bicchieri, bottiglie, barattoli, tazze, vasi, scatole, fiaschi, boccali, calici, tetrapack e via dicendo.

Senza alcun commento mostro in successione esempi reali di oggetti appartenenti alle categorie sopra descritte.

La persona può guardare, odorare, toccare e soppesare gli oggetti mostrati.

Dopo aver esaminato un sufficiente numero di oggetti, la persona facilmente sarà in grado di raggruppare gli oggetti in categorie contenenti gli oggetti fra di loro globalmente simili, privilegiando alcune caratteristiche rispetto ad altre ritenute ininfluenti perché non discriminanti.

Ad apprendimento avvenuto, io potrei presentare un altro oggetto a forma di bicchiere di altro colore, di altro materiale e di altro peso ottenendo comunque la collocazione dell'oggetto nella categoria dei bicchieri.

Sempre per induzione la persona in addestramento potrebbe fare due categorie dei bicchieri: quelli senza manico e quelli con manico (boccali).

L'apprendimento ha consentito alla persona di riconoscere gli aspetti dell'oggetto utili per passare dal particolare all'universale trascurandone gli aspetti non influenti.

Gli algoritmi basati sulle reti neurali, con particolare riferimento alle mappe di Kohonen (SOM Self Organizing Map), si basano sui principi appena illustrati nell'esempio.

Tale modello di Rete Neurale riflette in modo significativo i meccanismi biologici del sistema nervoso centrale; molti studi hanno infatti dimostrato che sulla superficie della corteccia celebrale esistono delle zone ben definite, ciascuna delle quali risponde ad una precisa funzione sensoria o motoria.

Ogni neurone si specializza a rispondere a determinati stimoli attraverso un’interazione continua con i neuroni confinanti.

Avremo quindi zone riservate all’udito, alla visione, all’attività motoria etc., e la demarcazione spaziale tra i diversi gruppi è tanto netta che si parla di formazione di bolle di attività.

Il modello di Rete Neurale presentato da Kohonen imita il comportamento sopra descritto.

L’architettura è abbastanza semplice; la rete è formata da una griglia rettangolare, detta anche strato di Kohonen, composta dai neuroni del livello di output, ciascuno dei quali occupa una precisa posizione ed è collegato a tutte le unità di ingresso.

I pesi delle connessioni tra il livello di input e quello di output sono aggiornati grazie al processo di apprendimento, mentre le connessioni tra i neuroni del livello di output presentano pesi che producono eccitazione tra i neuroni limitrofi ed inibizione tra i neuroni lontani.

Le reti di Kohonen sono definite anche reti competitive poiché si basano sul principio di competizione tra i neuroni per vincere e rimanere attivi; solo i pesi delle unità attive sono modificati. L’unità vincente i* è quella che possiede il potenziale di attivazione maggiore; quanto più un’unità è attiva per un certo pattern di ingresso, tanto più il vettore dei pesi sinaptici è simile a tale pattern.

In base a questo assunto è possibile trovare l’unità vincente calcolando la distanza euclidea tra il vettore di input ed il relativo vettore di pesi sinaptici. A questo punto si seleziona il neurone i* cui corrisponde la distanza minima.

Una volta determinato il neurone vincitore viene effettuato un aggiornamento automatico dei pesi del neurone stesso e di quelli che fanno parte del suo vicinato, in base ad una regola di tipo hebbiano.

In particolare si prende in considerazione una formula di modifica dei pesi che deriva dall’originale regola di Hebb; dato che quest’ultima farebbe crescere i pesi all’infinito viene introdotto un fattore di dimenticanza, spingendo i pesi verso i vettori di ingresso ai quali l’unità risponde maggiormente.

Si crea in questo modo una mappa relativa alle caratteristiche degli input dove unità limitrofe rispondono a determinati stimoli di ingresso grazie alla similarità dei pesi sinaptici.

A questo proposito è necessario introdurre anche il concetto di funzione di vicinanza, che determina l’area di ampiezza r intorno ad i* in cui le unità sono attive.

Minore è la dimensione del vicinato, minore è il numero di unità dello strato di Kohonen i cui pesi sono modificati significativamente, quindi maggiore è la capacità dei neuroni di differenziarsi e di acquisire dettagli ma anche la complessità del sistema di apprendimento.

Secondo Kohonen l’ampiezza della funzione di vicinanza deve essere fatta variare, scegliendola inizialmente in modo da coprire tutte le unità dello strato e facendola decrescere gradualmente.

In questo modo si passerà dall’apprendimento delle caratteristiche di ingresso di base all’apprendimento di dettagli e di specializzazione delle aree nel rispondere a determinati stimoli.

Conclusa la fase di addestramento la rete è in grado di fornire risposte in corrispondenza dei nuovi input presentati. La proprietà di generalizzazione deriva dal fatto che anche i neuroni vicini a quello selezionato sono modificati.

La rete dovrà quindi auto organizzarsi in aree costituite da un ampio insieme di valori attorno all’input dal quale apprende; questo farà sì che se è presentato un input mai visto prima ma con caratteristiche simili, la rete sarà in grado di classificarlo nel modo appropriato.

Rispetto agli algoritmi di tipo supervisionato, inoltre, il processo di apprendimento auto organizzato risulta efficiente anche se vengono utilizzati dati di input incompleti o contenenti errori, caratteristica che rende queste reti particolarmente adatte ad essere applicate nel processo di Data Mining.

Infatti l'algoritmo di Kohonen, al termine della fase di addestramento non supervisionato, produce una matrice tridimensionale che può essere utilizzata per la classificazione di nuove registrazioni nei gruppi con caratteristiche di maggiore somiglianza.

Mentre la fase di addestramento può richiedere molto tempo di elaborazione, quella di classificazione di nuove registrazioni nei gruppi con maggiore somiglianza è quasi istantanea, rendendo questa funzione utilmente applicabile a processi decisori in tempo reale (es. controllo di qualità in produzione, automazione di processo, sistemi di controllo, etc.).

Gli algoritmi delle reti neurali hanno, come aspetto comune, di non spiegare le caratteristiche dei gruppi ottenuti.

E' però possibile, utilizzando le informazioni contenute nella matrice di addestramento ed altre tecniche statistiche, fornire le informazioni sulle caratteristiche di ogni gruppo aiutando il ricercatore nell'approfondire l'analisi dei risultati per meglio documentare le conclusioni della sua ricerca.

E' anche possibile determinare quanto la globalità delle registrazioni utilizzate in fase di addestramento abbia dei contenuti di conoscenza o, al contrario, sia composta da dati fra di loro poco correlati e quindi non idonei ai fini della ricerca: infatti è possibile calcolare un indice globale di omogeneità dei gruppi nel loro insieme, informando il ricercatore sull'idoneità dell'archivio dei dati sottoposti ad elaborazione di conseguire gli obiettivi attesi.

Contact us

Visite:

(1734)